博文

专题综述 | 大语言模型中的知识生命周期

||

知识在人工智能发展中起着至关重要的作用。近年来,大规模语言模型(LLMs)取得了令人瞩目的进展,引发了人们对语言模型获取、维护、更新和使用知识方面的极大关注。尽管已经存在大量的相关研究,但学界对于知识如何在语言模型的学习、调整和应用过程中流动的完整生命周期,仍然缺乏整体性的观点,这可能会阻碍人们深入了解各个研究方向之间的联系,以及认识到现有研究中所存在的局限性。因此,本综述将语言模型视作一个大规模的知识系统,将知识在大规模语言模型中的生命周期划分为五个关键阶段,研究语言模型中的知识在构建、维护和使用过程中如何流动和循环。为此,本文系统性地回顾了知识在语言模型中生命周期的各个阶段的代表性研究,总结了当前每个阶段的核心挑战和主要局限性,并讨论了未来潜在的发展方向。相关成果已发表于《机器智能研究(英文)》2024年第2期中。

全文下载:

The Life Cycle of Knowledge in Big Language Models: A Survey

Boxi Cao, Hongyu Lin, Xianpei Han, Le Sun

https://link.springer.com/article/10.1007/s11633-023-1416-x

https://www.mi-research.net/en/article/doi/10.1007/s11633-023-1416-x

全文导读

从根本上来说,人工智能是一门研究知识的科学--如何表示、获取和使用知识的科学。

---尼尔森(1974年)

知识是通向高级智能的关键。一直以来,模型如何获取、存储、理解和应用知识一直都是机器智能领域的重要研究课题。近年来,大规模语言模型(LLMs)取得了飞速的发展。通过在大规模无标注语料库上进行自监督预训练,再通过指令微调和强化学习等手段与人类偏好对齐,大规模语言模型在不同领域、任务、数据集中表现出了远超以往方法的泛化和迁移能力,从而在人工智能领域取得了令人瞩目的成就。

大规模语言模型的成功引起了人们对其隐含知识的极大关注。许多研究都已经在关注大规模语言模型如何获取、维护和使用知识。基于此,研究者们探索了许多新的研究方向。例如,知识注入旨在将显式结构化知识注入LLM的参数中;知识探测用于评估存储在LLM参数中的知识类型和数量;知识编辑旨在修改LLM中不正确的或者过时的知识。

尽管有大量的相关研究,但目前的研究主要还是集中在知识在语言模型中的某一特定阶段,而对知识如何在整个模型学习、调整和应用阶段中循环缺乏一个统一视角。由于缺乏这种全面的研究,研究者们难以充分理解不同知识型任务之间的联系,发现LLM知识生命周期中不同阶段之间的相关性,以及探索现有研究的不足和局限性。例如,虽然许多研究致力于评估预训练语言模型中的知识,但很少有研究探讨为什么语言模型可以在没有任何知识监督的情况下从纯文本中学习海量的知识,以及语言模型表示和存储这些知识背后的机制。同时,许多研究尝试向LLM显示注入各类结构化知识,但少有研究尝试深入研究模型潜在的知识获取机制来帮助LLM更好地从纯文本中学习特定种类的知识。因此,该领域内的研究可能会过度关注某几个方向,而难以全面理解、维护和控制LLM中的知识,从而限制相关研究的进一步改进和应用。

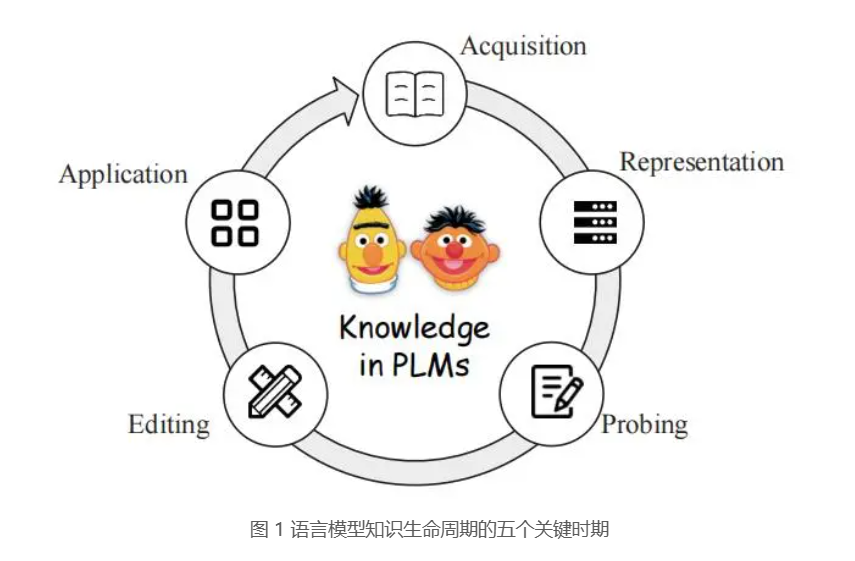

本综述提出从知识工程的角度系统回顾大规模语言模型中与知识相关的研究。受认知科学和知识工程研究的启发,本文将大规模语言模型视为基于知识的系统,并研究知识在语言模型中的获取、维护和使用的完整生命周期。具体来说,本文将大规模语言模型中知识的生命周期分为以下五个关键阶段,如图 1 所示:

• 知识获取:旨在研究语言模型从文本或其他知识源中学习各类知识的方法和机制。

• 知识表示:旨在研究各种知识在语言模型参数中编码、存储和分布的规律和机制。

• 知识探测:旨在探究语言模型中包含知识的种类,以及对相应知识规模的量化分析。

• 知识编辑:旨在编辑或者删除语言模型中存储的特定知识。

• 知识应用:旨在将大规模语言模型中的知识应用于真实场景中。

对于每个阶段,本文系统性地梳理了现有的研究,总结了主要挑战和局限性,并讨论了未来的发展方向。基于一个统一的视角,本文能够帮助理解和利用语言模型知识生命周期不同阶段之间的密切联系,而不是将其视为独立的任务。例如,了解语言模型的知识表示机制对研究人员设计更好的知识获取目标和知识编辑策略具备启发性的价值。提出可靠的知识探测方法可以帮助研究者们找到更适合不同语言模型的应用场景,并深入了解其局限性,从而促进其进一步的改进。我们希望通过该综述全面总结当前研究的进展、挑战和局限,帮助研究人员从新的视角更好地理解整个领域,并从整体性角度阐明如何更好地规范、表示和应用语言模型中的知识的未来方向。

本文贡献总结如下:

1) 本文将大规模语言模型视作一个新时代的知识系统,并将大规模语言模型中知识的生命周期划分为五个关键阶段。

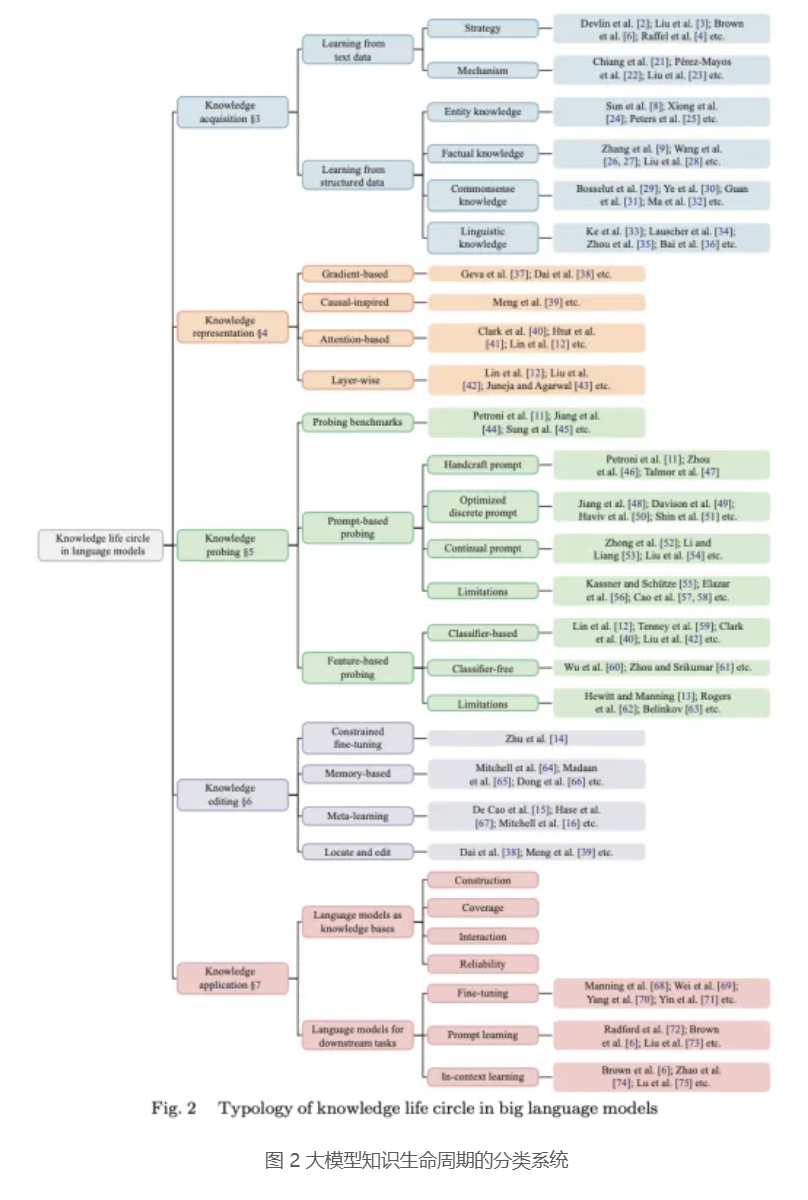

2) 如图2所示,针对每个阶段,本文系统性地回顾了现有研究,总结了每个研究方向的主要挑战和不足。

3) 在此基础上,本文讨论了当前研究的局限性,并阐明了未来的潜在发展方向。

全文下载:

The Life Cycle of Knowledge in Big Language Models: A Survey

Boxi Cao, Hongyu Lin, Xianpei Han, Le Sun

https://link.springer.com/article/10.1007/s11633-023-1416-x

https://www.mi-research.net/en/article/doi/10.1007/s11633-023-1416-x

BibTex:

@Article {MIR-2022-10-329,

author={ Boxi Cao, Hongyu Lin, Xianpei Han, Le Sun },

journal={Machine Intelligence Research},

title={The Life Cycle of Knowledge in Big Language Models: A Survey},

year={2024},

volume={21},

issue={2},

pages={217-238},

doi={10.1007/s11633-023-1416-x}}

纸刊免费寄送

Machine Intelligence Research

MIR为所有读者提供免费寄送纸刊服务,如您对本篇文章感兴趣,请点击下方链接填写收件地址,编辑部将尽快为您免费寄送纸版全文!

说明:如遇特殊原因无法寄达的,将推迟邮寄时间,咨询电话010-82544737

收件信息登记:

https://www.wjx.cn/vm/eIyIAAI.aspx#

关于Machine Intelligence Research

Machine Intelligence Research(简称MIR,原刊名International Journal of Automation and Computing)由中国科学院自动化研究所主办,于2022年正式出版。MIR立足国内、面向全球,着眼于服务国家战略需求,刊发机器智能领域最新原创研究性论文、综述、评论等,全面报道国际机器智能领域的基础理论和前沿创新研究成果,促进国际学术交流与学科发展,服务国家人工智能科技进步。期刊入选"中国科技期刊卓越行动计划",已被ESCI、EI、Scopus、中国科技核心期刊、CSCD等20余家国际数据库收录,入选图像图形领域期刊分级目录-T2级知名期刊。2022年首个CiteScore分值达8.4,在计算机科学、工程、数学三大领域的八个子方向排名均跻身Q1区,最佳排名挺进Top 4%。

往期目录

2023年第6期 | 影像组学、机器学习、图像盲去噪、深度估计...

2023年第5期 | 生成式人工智能系统、智能网联汽车、毫秒级人脸检测器、个性化联邦学习框架... (机器智能研究MIR)

2023年第4期 | 大规模多模态预训练模型、机器翻译、联邦学习......

2023年第3期 | 人机对抗智能、边缘智能、掩码图像重建、强化学习...

2023年第2期 · 特约专题 | 大规模预训练: 数据、模型和微调

2023年第1期 | 类脑智能机器人、联邦学习、视觉-语言预训练、伪装目标检测...

2022年第6期 | 因果推理、视觉表征学习、视频息肉分割...

2022年第4期 | 来自苏黎世联邦理工学院Luc Van Gool教授团队、清华大学戴琼海院士团队等

2022年第3期 | 聚焦自然语言处理、机器学习等领域;来自复旦大学、中国科学院自动化所等团队

2022年第2期 | 聚焦知识挖掘、5G、强化学习等领域;来自联想研究院、中国科学院自动化所等团队

好文推荐

精选综述 | 零信任架构的自动化和编排: 潜在解决方案与挑战

欧洲科学院院士蒋田仔团队 | 脑成像数据的多模态融合: 方法与应用

专题好文 | 创新视听内容的联合创作: 计算机艺术面临的新挑战

下载量TOP好文 | 人工智能领域高下载文章集锦 (2022-2023年)

引用量TOP好文 | 人工智能领域高引用文章集锦 (2022-2023年)

哈工大江俊君团队 | DepthFormer: 利用长程关联和局部信息进行精确的单目深度估计

Luc Van Gool团队 | 通过Swin-Conv-UNet和数据合成实现实用图像盲去噪

贺威团队&王耀南院士团队 | 基于动态运动基元的机器人技能学习

乔红院士团队 | 类脑智能机器人:理论分析与系统应用 (机器智能研究MIR)

南科大于仕琪团队 | YuNet:一个速度为毫秒级的人脸检测器

上海交大严骏驰团队 | 综述: 求解布尔可满足性问题(SAT)的机器学习方法

前沿观点 | 谷歌BARD的视觉理解能力如何?对开放挑战的实证研究

港中文黄锦辉团队 | 综述: 任务型对话对话策略学习的强化学习方法

南航张道强教授团队 | 综述:用于脑影像基因组学的机器学习方法

ETHZ团队 | 一种基于深度梯度学习的高效伪装目标检测方法 (机器智能研究MIR)

Luc Van Gool团队 | 深度学习视角下的视频息肉分割

专题好文 | 新型类脑去噪内源生成模型: 解决复杂噪音下的手写数字识别问题

戴琼海院士团队 | 用以图像去遮挡的基于事件增强的多模态融合混合网络

ETH Zurich重磅综述 | 人脸-素描合成:一个新的挑战

MIR资讯

征稿启事 | AIART 2024 Call for Papers

专题征稿 | Special Issue on Transformers for Medical Image Analysis

MIR 优秀编委 & 优秀审稿人 & 高被引论文 (2023年度)

致谢审稿人 | Machine Intelligence Research

年终喜报!MIR科技期刊世界影响力指数跻身Q1区 (含100份龙年礼包)

2022影响因子发布!人工智能领域最新SCI & ESCI期刊一览

双喜!MIR入选”2022中国科技核心期刊”,并被DBLP收录 | 机器智能研究MIR

https://m.sciencenet.cn/blog-749317-1429801.html

上一篇:精选综述 | 零信任架构的自动化和编排: 潜在解决方案与挑战

下一篇:特别提醒!请认准MIR官方渠道,谨防受骗