博文

前景约束下的抗干扰匹配目标跟踪方法

|

引用本文

刘大千, 刘万军, 费博雯, 曲海成. 前景约束下的抗干扰匹配目标跟踪方法. 自动化学报, 2018, 44(6): 1138-1152. doi: 10.16383/j.aas.2017.c160475

LIU Da-Qian, LIU Wan-Jun, FEI Bo-Wen, QU Hai-Cheng. A New Method of Anti-interference Matching Under Foreground Constraint for Target Tracking. ACTA AUTOMATICA SINICA, 2018, 44(6): 1138-1152. doi: 10.16383/j.aas.2017.c160475

http://www.aas.net.cn/cn/article/doi/10.16383/j.aas.2017.c160475

关键词

前景约束,抗干扰匹配,判别外观模型,决策判定,特征补偿

摘要

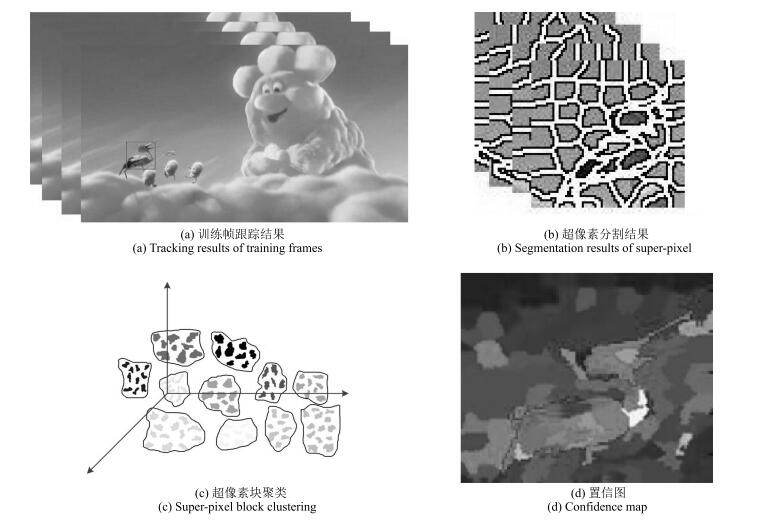

传统模型匹配跟踪方法没有充分考虑目标与所处图像的关系,尤其在复杂背景下,发生遮挡时易丢失目标.针对上述问题,提出一种前景约束下的抗干扰匹配(Anti-interference matching under foreground constraint,AMFC)目标跟踪方法.该方法首先选取图像帧序列前m帧进行跟踪训练,将每帧图像基于颜色特征分割成若干超像素块,利用均值聚类组建簇集合,并通过该集合建立判别外观模型;然后,采用EM(Expectation maximization)模型建立约束性前景区域,通过基于LK(Lucas-Kanade)光流法框架下的模型匹配寻找最佳匹配块.为了避免前景区域中相似物体的干扰,提出一种抗干扰匹配的决策判定算法提高匹配的准确率;最后,为了对目标的描述更加准确,提出一种新的在线模型更新算法,当目标发生严重遮挡时,在特征集中加入适当特征补偿,使得更新的外观模型更为准确.实验结果表明,该算法克服了目标形变、目标旋转移动、光照变化、部分遮挡、复杂环境的影响,具有跟踪准确和适应性强的特点.

文章导读

基于视频序列的运动目标跟踪技术是计算机视觉领域研究的热点问题, 在人机交互、智能交通、医学图像处理[1-4]等领域发挥着重大作用.近年来, 国内外的专家学者围绕基于目标自身特征匹配[5-6]、基于运动估计[7-8]和基于模型匹配[9-10]这三种主流跟踪方法进行深入研究.基于目标自身特性匹配的跟踪方法, 在首帧中选取目标自身的特征信息, 并在其后帧中寻找该特征.寻找过程即为在视频序列中对目标的特征匹配和跟踪.常用的特征主要有几何形态、子空间信息、目标轮廓和特定特征点等, 例如SURF特征点检测和Harris角点检测.由于目标在不断移动过程中, 其自身特性(姿态、大小)也会发生改变, 具有随机性, 通常采用数字统计的方法来描述, 例如像素灰度直方图、边缘方向梯度图等.

基于运动估计的跟踪方法主要是通过预测下一帧中目标可能出现的区域, 并以区域中心向外扩充的方式对目标进行跟踪.在跟踪过程中如果对图像中所有场景信息逐一进行模型匹配, 需要处理大量冗余信息, 计算复杂度较高.基于运动估计的跟踪方法从一定程度上限制了目标的匹配范围, 降低了计算复杂度, 满足跟踪算法对时效性的要求.其中最具有代表性的是卡尔曼滤波方法.卡尔曼滤波是一种线性递归滤波, 主要针对当前序列状态对下一时刻目标的状态做出最佳评估.施华等[11]提出一种利用像素可信度和空间位置的跟踪方法, 通过卡尔曼滤波在时域中的背景模型与空间域的交叉熵协同实现对目标的检测和跟踪.

基于模型匹配的跟踪方法通过对目标的外观模型进行相似性分析来实现跟踪, 其中外观模型用来评估候选目标在特定位置的似然性, 在模型匹配中起着至关重要的作用.一种鲁棒的外观模型能够高效地解决场景中的光照变化、非目标物体遮挡、目标形态变化等问题.基于模型匹配的跟踪方法还分为基于整体模型的跟踪和基于局部模型的跟踪.基于整体模型的跟踪利用选定的目标区域建立整体模型进行模型匹配和跟踪. Babenko等[12]通过对选定目标区域进行正/负样本的学习模型, 从而构建判别式模型实现跟踪.基于局部模型的跟踪将目标区域进行分块处理, 利用分割的局部子区域进行匹配跟踪, 并实时更新局部模型, 例如Oron等[13]提出的局部无序跟踪(Locally orderless tracking, LOT)算法, 将目标分割为多个超像素块, 通过超像素块的匹配对目标进行跟踪, 同时利用粒子滤波对目标模型匹配加以约束, 使得跟踪具有较高的鲁棒性.徐如意等[14]在LK (Lucas-Kanade)图像配准框架下, 将稀疏表示目标跟踪算法利用求解的正则化来确定目标的特征模型, 并创建动态字典用于模型的实时更新, 从而准确跟踪目标. Wang等[15]提出一种超像素跟踪(Super-pixel tracking, SPT)算法, 从背景中提取目标构建一个具有区分度的判别外观模型, 通过使用最大后验估计和超像素置信度计算下一时刻目标可能出现的位置, 并实时更新外观模型.但基于模型匹配的跟踪方法仍存在一些问题, 例如在模型匹配过程中, 目标发生严重遮挡或图像背景较为复杂, 使得构建外观模型的难度增加且目标容易淹没在背景中, 导致跟踪漂移, 甚至丢失目标.

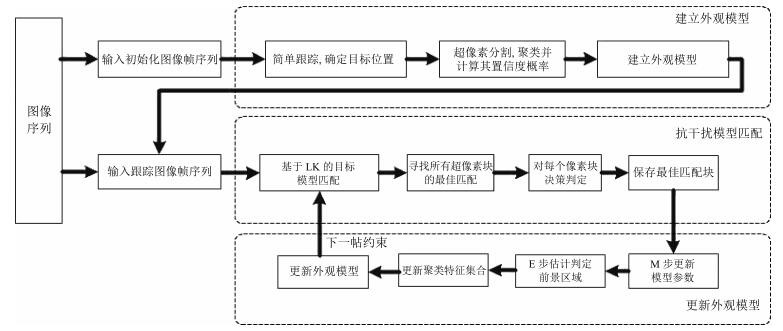

针对上述问题, 提出一种前景约束下的抗干扰匹配(Anti-interference matching under foreground constraint, AMFC)目标跟踪方法.首先在前m帧图像序列中使用简单的模型匹配算法进行跟踪, 确定m帧图像的目标区域, 利用超像素分割所获得的目标区域, 建立由若干超像素块组成的训练样本集, 将具有相同颜色特征的超像素块集合进行均值聚类组建簇集合, 计算每个簇的置信度概率, 建立初始判别外观模型.然后利用基于LK光流法框架下的模型匹配, 寻找最佳匹配块, 引入高斯噪声模型防止强光照对目标跟踪的影响.同时, 算法还引入决策判定, 避免前景区域中相似物体的干扰, 进而实现精确的目标跟踪.最后利用EM (Expectation maximization)模型估计下一帧图像的前景参数信息, 并对目标是否发生严重遮挡进行判断, 若发生遮挡, 在特征集中加入适当补偿, 即可获得新的判别外观模型.

本文的主要贡献为: 1)将图像的前几帧作为训练样本集, 通过聚类构建目标模型, 滤除背景信息的干扰, 得到较鲁棒的目标模型. 2)对图像帧中的前景信息进行估计, 对局部模型的匹配过程进行约束.只在前景区域中寻找最佳匹配的超像素块, 达到局部最优匹配. 3)在匹配过程中引入决策判定, 只保留限定区间内的最佳匹配块, 排除与目标相似物体的干扰, 提高算法匹配抗干扰性. 4)在模型更新中对目标是否发生严重遮挡进行判断, 若发生遮挡, 在特征集中加入适当补偿, 使更新的外观模型对目标的描述更加准确.

图 1 AMFC算法流程示例图

图 2 建立判别外观模型过程

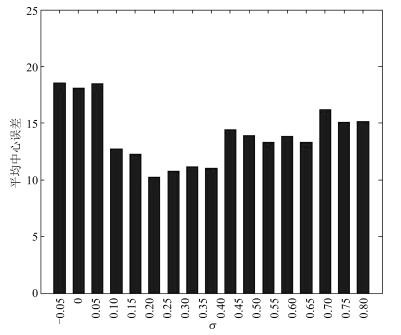

图 3 σ值与平均中心误差之间的关系

本文提出了一种前景约束下的抗干扰匹配目标跟踪方法, 利用图像的前景判别, 突出了目标的重要区域, 为特定目标的识别跟踪提供了新的思路.通过EM模型对前景信息的估计解决了模板匹配中的误识问题.在匹配过程中, 引入决策判定, 排除与目标相似物体的干扰, 提高算法匹配的抗干扰性.在模型更新中, 算法对目标是否发生严重遮挡进行判断, 当发生严重遮挡时, 在特征集中加入适当补偿, 使更新的外观模型对目标的描述更加准确, 提高了跟踪的可靠性.

通过对标准库中的12组视频图像序列进行实验对比分析, 结果表明, AMFC算法在目标形变、目标旋转移动、光照变化、部分遮挡、复杂环境等干扰因素的影响下均可以得到较高的跟踪准确性.

AMFC算法虽然引入了图像特征的前景信息, 但对于目标不规则运动和目标发生全局遮挡时跟踪的准确率不高.在未来的工作中, 将针对目标的特征做进一步分析研究.

作者简介

刘大千

辽宁工程技术大学电子与信息工程学院博士研究生.2016年获得辽宁工程技术大学硕士学位.主要研究方向为图像与视觉信息计算, 目标的检测与跟踪.E-mail:liudaqianlntu@163.com

费博雯

辽宁工程技术大学工商管理学院博士研究生.2016年获得辽宁工程技术大学硕士学位.主要研究方向为数据挖掘, 模式识别.E-mail:feibowen2098@163.com

曲海成

辽宁工程技术大学副教授.2016年获得哈尔滨工业大学博士学位.主要研究方向为遥感高性能计算技术.E-mail:quhaicheng@lntu.edu.cn

刘万军

辽宁工程技术大学软件学院教授.1991年获得辽宁工程技术大学硕士学位.主要研究方向为图像与视觉信息计算, 目标的检测与跟踪.本文通信作者.E-mail:liuwanjun@lntu.edu.cn

https://m.sciencenet.cn/blog-3291369-1419309.html

上一篇:面向分布式数据流大数据分类的多变量决策树

下一篇:IEEE/CAA J. Autom. Sinica 2023年发文合集